Diese Angriffsszenarien auf ihre KI-Modelle sollten Unternehmen kennen

Enorm schnell gewinnt KI an Bedeutung und erobert immer mehr Branchen und Unternehmen. Daher nehmen Cyberkriminelle verstärkt die KI-Modelle selbst ins Visier und versuchen beispielsweise, sie so zu manipulieren, dass sie sensible Daten preisgeben oder falsche Ergebnisse liefern. Dell Technologies hat sich mit den gängigen Angriffsarten auseinandergesetzt.

Das Wissen um die Bedrohungen hilft Unternehmen, Risiken richtig einzuschätzen, sinnvolle Prioritäten zu setzen und geeignete Sicherheitsmaßnahmen einzuleiten. Diese Aufgaben obliegen allerdings nicht allein dem Security-Team, denn Sicherheit muss von Anfang an mitgedacht werden – schon bei der Entwicklung und dem Training der Modelle, so die Fachleute von Dell.

Idealerweise arbeiten daher Sicherheitsspezialisten, KI-Experten und Software-Entwickler gemeinsam am Schutz von KI-Modellen und Daten. Folgende Bedrohungsszenarien sollten sie dabei berücksichtigen:

Modelldiebstahl: Da die Entwicklung und das Training von KI-Modellen sehr teuer und aufwendig sind, ist es für Cyberkriminelle attraktiv, Modelle zu stehlen oder günstig nachzubauen. Finden sich keine Sicherheitslücken, um gleich das gesamte Modell zu kopieren, können massenhafte Abfragen umfangreiche Informationen zu seinem Verhalten, den Gewichtungen und Parametern sowie zu den Trainingsdaten liefern. Damit lässt sich dann ein vergleichbares Modell erstellen.

Data Poisoning: Durch die Veränderung oder den Austausch von Trainingsdaten können Angreifer ein KI-Modell schwächen. Es arbeitet dann weniger genau oder wird unbrauchbar – möglicherweise auch nur in einem einzigen Bereich. Es lassen sich sogar Hintertüren einbauen: Das Modell liefert dann bei einem bestimmten Input – dem sogenannten Trigger – ein vom Angreifer gewünschtes Ergebnis. Es führt beispielsweise eine vorgegebene Aktion aus oder übersieht eine Bedrohung.

Model Inversion: Wie beim Modelldiebstahl wird die KI mit zahllosen Anfragen gefüttert – allerdings nicht, um Informationen zur Funktionsweise zu erhalten, sondern um sie zur Ausgabe von Trainingsdaten zu bewegen oder aus ihren Antworten bestimmte Trainingsdaten zu rekonstruieren. Auf diese Weise können schützenswerte Informationen – etwa personenbezogene Daten oder wertvolles geistiges Eigentum – aus dem Unternehmen abfließen.

Perturbation-Angriffe: Hier werden die Eingabedaten so manipuliert, dass die KI beispielsweise ungenaue Vorhersagen trifft, Daten falsch klassifiziert oder ein bestimmtes Ereignis übersieht. Dafür reichen schon kleine Veränderungen an Sensordaten, Texten oder Bildern. Die Auswirkungen können weitreichend sein, wenn es sich um kritische Systeme etwa zur Erkennung von Cyber-Angriffen oder zur Erkennung von Verkehrsschildern beim autonomen Fahren handelt.

Prompt Injection: Mit geschickt formulierten Anfragen versuchen Cyberkriminelle, die KI zu einem unerwünschten Verhalten zu bewegen. In harmlosen Fällen soll sie nur Schimpfworte verwenden oder andere unangemessene Inhalte ausgeben. Schwerer wiegt es, wenn es den Angreifern gelingt, ihr vertrauliche oder gefährliche Inhalte zu entlocken, etwa sensible interne Daten oder schädlichen Code.

Rewards Hacking: Beim Reinforcement Learning, dem bestärkenden oder verstärkenden Lernen, erhält die KI regelmäßig Feedback zu ihren Entscheidungen. Auf diese Weise lernt sie Schritt für Schritt, welche Entscheidung in einer bestimmten Situation die beste ist. Gelingt es Angreifern allerdings, das Belohnungssystem (Rewards System) zu manipulieren, trainiert sich die KI ein falsches oder nicht optimales Verhalten an und kann ihre künftigen Aufgaben nur unzureichend erfüllen.

DoS- und DDoS-Angriffe: Mit Denial-of-Service- beziehungsweise Distributed-Denial-of-Service-Angriffen lassen sich KI-Systeme überlasten, sodass sie besonders viele Ressourcen verbrauchen oder ihre Aufgaben nicht mehr wahrnehmen können. Damit werden wichtige Geschäftsprozesse im Unternehmen gestört oder Sicherheitssysteme lahmgelegt, um einen anderen Angriff vorzubereiten.

Kompromittierung der Lieferkette: Bei dieser Angriffsvariante kompromittieren Cyberkriminelle die Hardware und Software, die Unternehmen für die KI-Entwicklung und den KI-Einsatz von Dritten beziehen. Da die Infrastrukturen und Software-Stacks für KI meist sehr komplex sind, gibt es viele Systeme, Tools und Bibliotheken, die dafür in Frage kommen – selbst vortrainierte Modelle lassen sich manipulieren, wenn deren Anbieter sie nicht ausreichend schützen. Für die Angreifer reicht es, ein einziges schwaches Glied in der Lieferkette zu finden, um sich Zugang zu den KI-Systemen eines Unternehmens zu sichern.

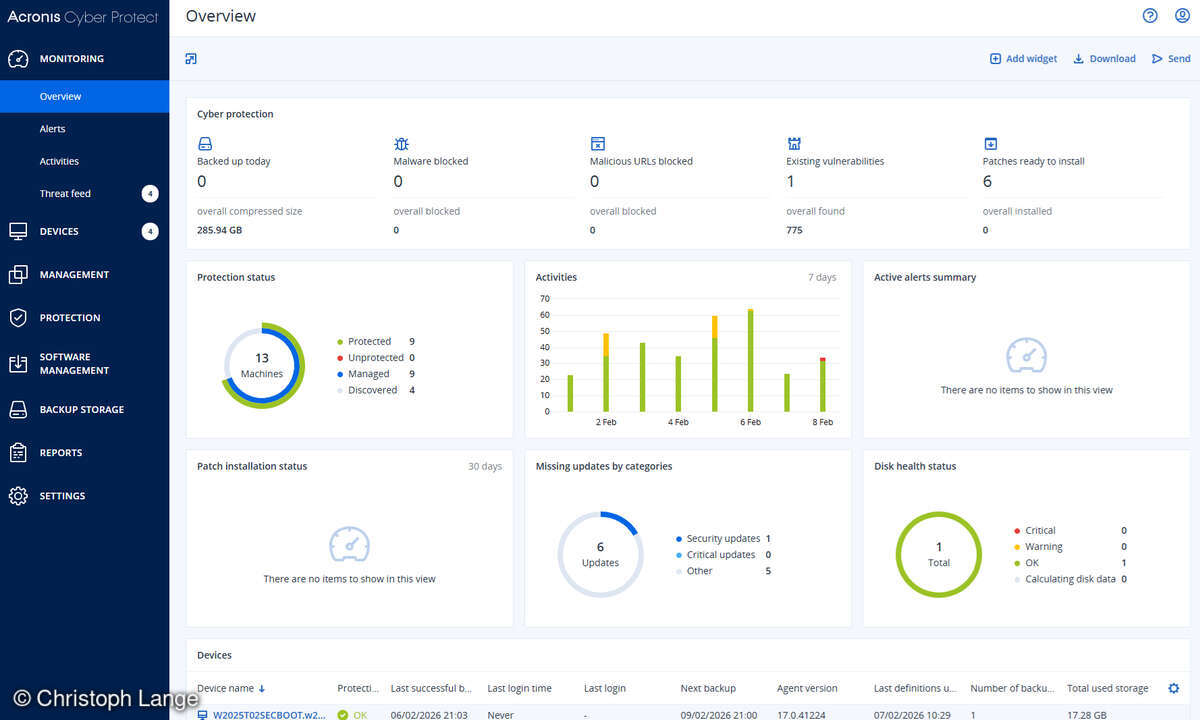

„Für KI ist ein umfassendes Sicherheitskonzept notwendig, das weit über Security-Basics wie sichere Zugriffskontrollen, Verschlüsselung und Angriffserkennung hinausgeht“, betont Christian Scharrer, Enterprise Architect und CTO Ambassador bei Dell Technologies in Deutschland. „Unternehmen müssen sowohl Trainings- als auch Input-Daten sorgfältig validieren und bereinigen und sogenannte Guardrails implementieren, die alle Ein- und Ausgaben überprüfen. Darüber hinaus benötigen sie Tools, die sie bei der Überwachung der Modelle unterstützen und Leistungsveränderungen erkennen – und natürlich sichere Lieferketten für Hardware und Software.“