Generative KI und Cybersecurity: Zwischen Produktivitätsschub und Risiko-Eskalation

Generative KI steigert Produktivität, aber auch die Effizienz von Cyberangriffen. Warum Unternehmen zwischen Innovationsdruck und Sicherheitsrisiken neu denken müssen und welche Rolle Governance spielt, erklärt Dr. Frank Beer, Principal AI bei Infodas.

- Generative KI und Cybersecurity: Zwischen Produktivitätsschub und Risiko-Eskalation

- Glossar: Zentrale Begriffe rund um generative KI und Cybersecurity

Generative KI gilt als Produktivitätsmotor der digitalen Transformation. Sie automatisiert Routinen, beschleunigt Entscheidungen und unterstützt kreative Prozesse. Studien renommierter Beratungshäuser prognostizieren deutliche Effizienzgewinne im Arbeitsalltag ebenso wie in volkswirtschaftlichen Kennzahlen. Eine Analyse des McKinsey Global Institute beziffert das zusätzliche Wertschöpfungspotenzial generativer KI auf mehrere Billionen US-Dollar pro Jahr. Doch dieselbe Technologie eröffnet neue Angriffsflächen. Genau hier setzt das von Infodas beschriebene „Dilemma der generativen KI“ an: Sie ist Innovationshebel und Risikoquelle zugleich.

Anbieter zum Thema

Frank Beer, Principal AI bei Infodas (Eigenschreibweise „infodas“), beobachtet seit dem „Big Bang“ durch ChatGPT Ende 2022 eine typische Wellenbewegung: „Da gab es totale Euphorie tatsächlich.“ Schnell seien jedoch fehlende Kompetenzen, unklare Verantwortlichkeiten und rechtliche Unsicherheiten sichtbar geworden. Heute herrsche vielerorts vorsichtiges Beobachten bei Entscheidern – während der Druck aus der Belegschaft wachse.

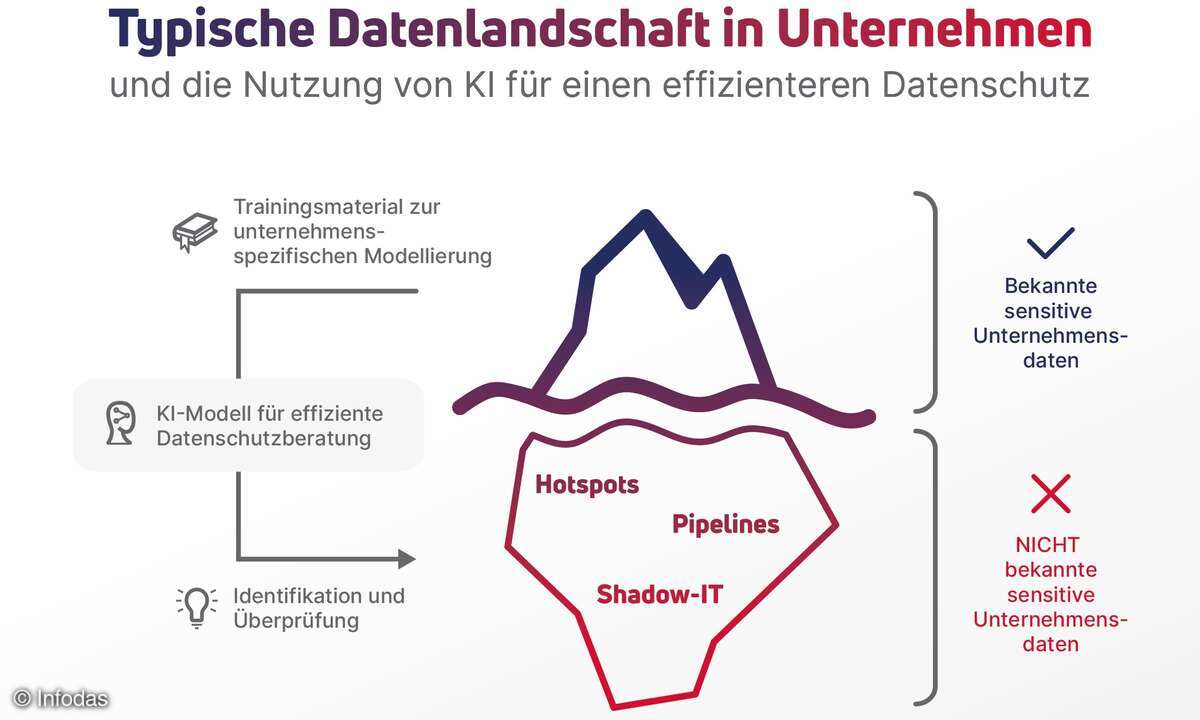

„Wenn das Unternehmen nicht aktiv steuert, handeln die Mitarbeitenden selbst – und die Organisation gerät hinter die Welle“, warnt Beer. Gemeint ist Schatten-IT: Mitarbeitende nutzen KI-Tools eigenständig, ohne Governance, Schulung oder Sicherheitsrahmen. Das Risiko: Datenabfluss über unkontrollierte Kanäle – ein „Datenleck wie im Lehrbuch“.

Professionalisierte Angreifer, intelligentere Angriffe

Die Bedrohungslage hat sich nach Einschätzung von Infodas 2025 spürbar verschärft. In einer Reevaluation ihres Data-Leakage-Reports aus 2024 stellte das Unternehmen fest, „dass die Qualität von gewissen klassischen Angriffen deutlich mehr Durchschlagskraft aufweist“. Generative KI wirkt hier wie ein Multiplikator.

Generative KI wird insbesondere in der Reconnaissance-Phase eingesetzt, um Schwachstellen schneller zu identifizieren und maßgeschneiderte Angriffe zu entwickeln. Hinzu kommen KI-generierte Malware-Varianten und sogenannte Dark-LLMs, die gezielt für kriminelle Zwecke optimiert wurden. Besonders dynamisch entwickelt sich das Feld des KI-gestützten Phishings. LLMs erzeugen sprachlich fehlerfreie, überzeugende Nachrichten und senken den Aufwand drastisch. Auch Voice-Phishing (Vishing) gewinnt durch Voice-Cloning an Qualität und Skalierbarkeit.

Für Beer ist klar: „Primäres Ziel der opportunistischen Cyberkriminalität ist nach wie vor die finanzielle Bereicherung.“ Neben Erpressung durch Verschlüsselung sind gestohlen Daten auch ein bewährtes Druckmittel für eine erfolgreiche Monetarisierung. Gleichzeitig geraten legitime LLM-Dienste selbst ins Visier. Indirect Prompt Injections oder Zero-Click Exploits bei integrierten Assistenten wie Copilot oder Gemini zeigen, wie schnell produktiv genutzte KI-Systeme zur Einfallstür werden können.

Schatten-KI und die „explosive Mischung“

Wie weit sind Unternehmen bei der sicheren Integration generativer KI? „Meiner Wahrnehmung nach zeichnet sich gerade ab, dass Organisationen insbesondere in Deutschland dieser disruptiven Technologie hinterherlaufen“, so Beer. Auf anfängliche Euphorie folgte Zurückhaltung – und nun häufig planloser Aktionismus. Für Beer ist deshalb Transparenz der erste Schritt: „Man muss transparent mit der Thematik KI umgehen und ein Bewusstsein etablieren, dass KI nicht nur gut ist.“

Besonders problematisch sei ein vermeintlicher Sicherheitsreflex: generative KI zu verbieten oder zu ignorieren. Dadurch entstehe Frust in der Belegschaft – und Schatten-IT. „Wenn ein Mitarbeiter selbstständig handelt, ich gebe ihm gar keine Leitplanken und er dann noch mit gefährlichem Halbwissen agiert, ist das eben eine explosive Mischung.“ Das Risiko ist weniger böswillige Sabotage als unbeabsichtigtes Fehlverhalten. Wer ungeschult mit externen LLM-Diensten arbeitet, könne vertrauliche Informationen preisgeben – ein klassisches Datenleck. Gleichzeitig warnt Beer vor naiver Nutzung. KI liefere nicht automatisch korrekte Ergebnisse. Die Konsequenz: Der Mensch muss Experte bleiben, die KI ist Assistenzsystem.

Doch schriftliche Leitplanken allein reichen nicht. „Nachhaltig gelingt dies nur, wenn Risiken nicht abstrakt bleiben, sondern erlebbar gemacht werden.“ Praxisnahe Übungen, Simulationen und kontinuierliche Awareness-Trainings seien entscheidend, um Manipulationstechniken im KI-Zeitalter zu verstehen.

Auch regulatorisch steigt der Druck. Der EU AI Act definiert klare Anforderungen an Betreiber und Anbieter von KI-Systemen. Für Beer ist er faktisch ein Governance-Rahmen: „Du hast eine Pflicht als KI-Betreiber und -Anbieter entsprechende Anforderungen zu erfüllen und dazu gehört auch der Aufbau von notwendiger KI-Kompetenz für nutzende Mitarbeiter.“

Neben gesetzlichen Vorgaben existieren Standards wie ISO/IEC 42001, die KI systematisch in der Organisation verankern. Im Kern gehe es immer um Transparenz, klare Verantwortlichkeiten, Risikosteuerung und verbindliche Leitplanken.

Notfallpfade, Cloud-Fragen und strategische Souveränität

Ein oft unterschätzter Aspekt sind Notfall- und Abschaltpfade. „Notfall- und Abschaltpfade sind vordefinierte Mechanismen, mit denen ein Unternehmen die Nutzung eines generativen KI-Systems sofort einschränken, kontrollieren oder vollständig stoppen kann“. Doch ein reiner „Kill Switch“ genügt nicht: Wiederanlaufstrategien müssten definiert und geübt werden.

Parallel rückt die Frage nach Bereitstellungsmodellen in den Fokus. Cloud-Lösungen bieten enorme Skalierbarkeit, doch insbesondere im behördlichen oder KRITIS-Umfeld wird verstärkt über On-Premise-Ansätze nachgedacht – aus Gründen der Datensouveränität und Risikokontrolle. Beer beobachtet sogar Fälle, in denen Organisationen frühere Cloud-Entscheidungen wieder revidieren.

Gerade im KRITIS-Umfeld gewinne KI-Governance strategische Bedeutung. Infodas plant hier mit Industrie- und Wissenschaft ein Forschungsvorhaben für die vertrauenswürdige Nutzung von KI in sicherheitskritischen Bereichen. Ziel ist ein praxisnaher Rahmen, der Innovation ermöglicht, ohne Sicherheitsanforderungen zu unterlaufen.

Beers Botschaft an Entscheidungsträger ist klar: „Treten Sie für einen Moment einen Schritt zurück und überlegen Sie, ob und wo in meiner Organisation generative KI einen echten Mehrwert bringen kann.“ Potenzialanalysen, transparente Kommunikation und gezielte Befähigung der Mitarbeitenden seien die drei Hebel.

Denn am Ende entscheidet nicht die Technologie allein über Erfolg oder Misserfolg – sondern der Rahmen, in dem sie eingesetzt wird.

Generative KI: 3 Schritte für Entscheider

Dr. Frank Beer, Principal AI bei Infodas, formuliert drei klare Empfehlungen für die sichere Nutzung von generativer KI:

- Schritt zurücktreten und Potenziale prüfen. Nicht dem Hype folgen, sondern systematisch analysieren, wo generative KI echten Mehrwert stiftet. Potenzialanalysen helfen bei Priorisierung und Ressourcenallokation.

- Transparenz schaffen. KI darf kein Kellerprojekt sein. Die Belegschaft muss verstehen, welche Ziele verfolgt werden und welche Regeln gelten.

- Mitarbeitende befähigen. Awareness-Trainings, realitätsnahe Übungen und klare Leitplanken sind entscheidend. Nur wenn Risiken erlebbar werden, entsteht verantwortungsvolles Handeln.Das „Dilemma der generativen KI“ lässt sich nicht auflösen, aber man kann es gestalten. Unternehmen, die Governance als strategischen Hebel begreifen, sichern nicht nur Compliance, sondern langfristige Wettbewerbsfähigkeit in einer zunehmend KI-getriebenen Sicherheitslandschaft.