Die Zukunft der Videosicherheit: KI trifft Edge Computing

Edge AI ist einer der wichtigsten Anwendungsfälle für KI in der Videosicherheit. Die Kombination aus KI-basierter Analyse und effizienter Netzwerknutzung bietet zahlreiche Vorteile im Vergleich zu anderen Sicherheitsarchitekturen.

- Die Zukunft der Videosicherheit: KI trifft Edge Computing

- Anwendungsszenario: Autobahnsicherheit

Wenn sich zwei oder mehrere innovative Technologien sinnvoll kombinieren lassen, potenzieren sich ihre Vorteile im Idealfall. Im Bereich der videobasierten Sicherheit ist dies der Fall, wenn künstliche Intelligenz (KI) auf Edge Computing trifft – in diesem Fall spricht man von Edge AI. Die Vorteile, die sich durch diese Kombination hinsichtlich Funktionsumfang, Datenqualität und Netzwerknutzung ergeben, sind signifikant.

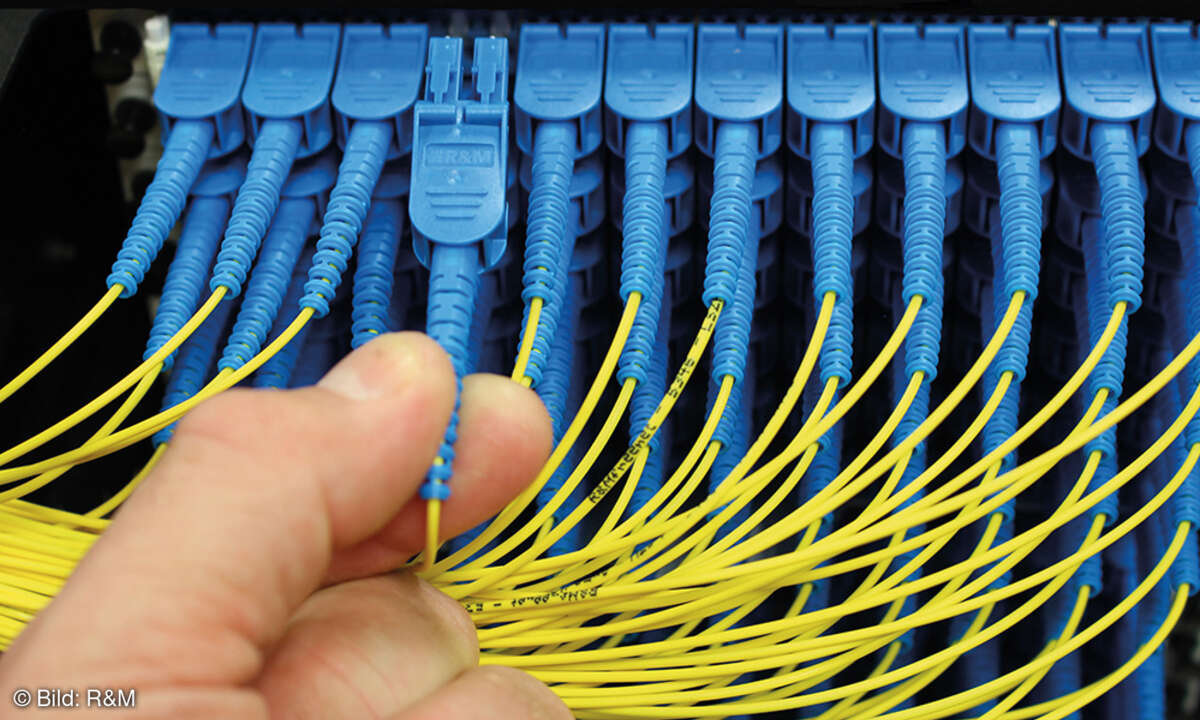

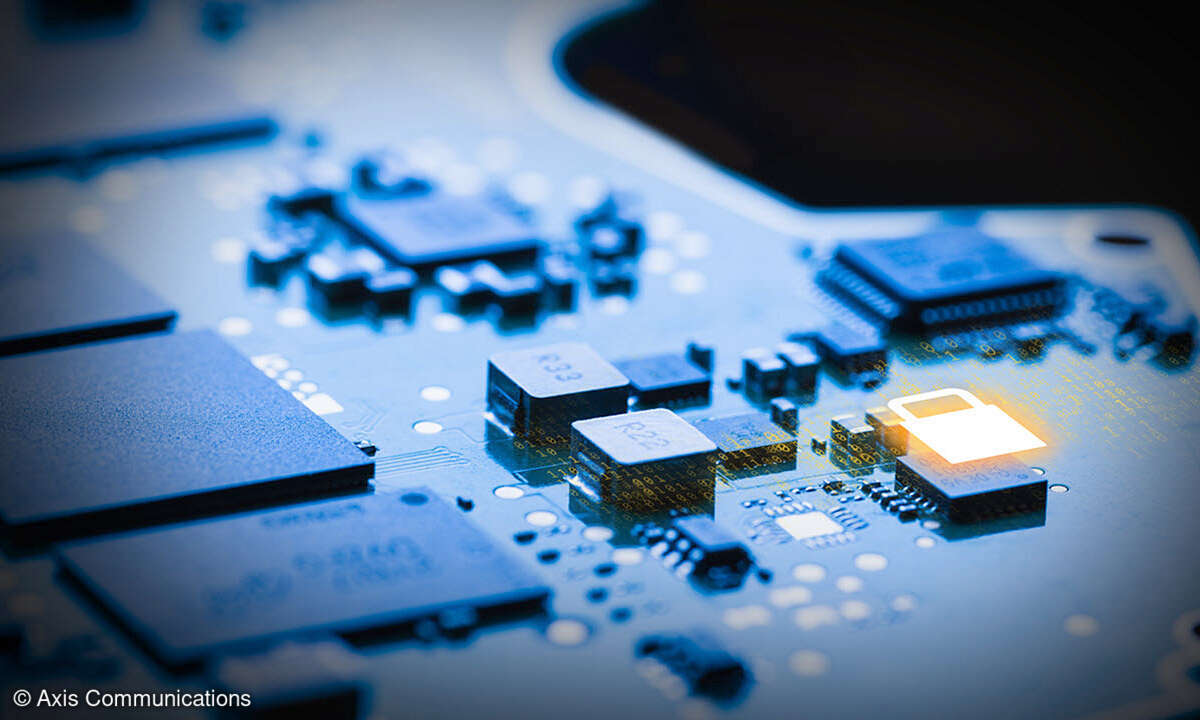

Einer der wichtigsten Treiber von Edge AI in diesem Bereich war die technologische Weiterentwicklung der Netzwerkkameras. Insbesondere die Integration moderner Prozessortechnologie in die Kameras sorgt für eine deutlich höhere Rechenleistung auf den Geräten selbst und damit für eine bessere Auflösung und Bildrate. Auch lassen sich damit komplexe Analytikfunktionen wie die Erkennung von Fahrzeugkennzeichen direkt auf den Kameras selbst ausführen – das sogannte Edge Computing. Die Kameras sind also nicht mehr nur dazu da, Bildmaterial an eine zentrale Stelle zu liefern, an der dann die Analyse stattfindet. Sie werden selbst zu intelligenten Sensoren.

Die Analytikfunktionen basieren auf KI. Sie werden durch Machine Learning Processing Units (MLPU) oder Deep Learning Processing Units (DLPU) ermöglicht, die in die verbesserten Prozessoren integriert sind, mit denen moderne Netzwerkkameras üblicherweise ausgestattet sind. Die großen technologischen Fortschritte im Bereich Machine Learning und Deep Learning in den vergangenen Jahren haben diese Integration noch einmal zusätzlich beschleunigt, sodass nun auch anspruchsvolle KI-Prozesse nach dem Prinzip des Edge Computing auf den Kameras ausgeführt werden können – Edge AI.

Anbieter zum Thema

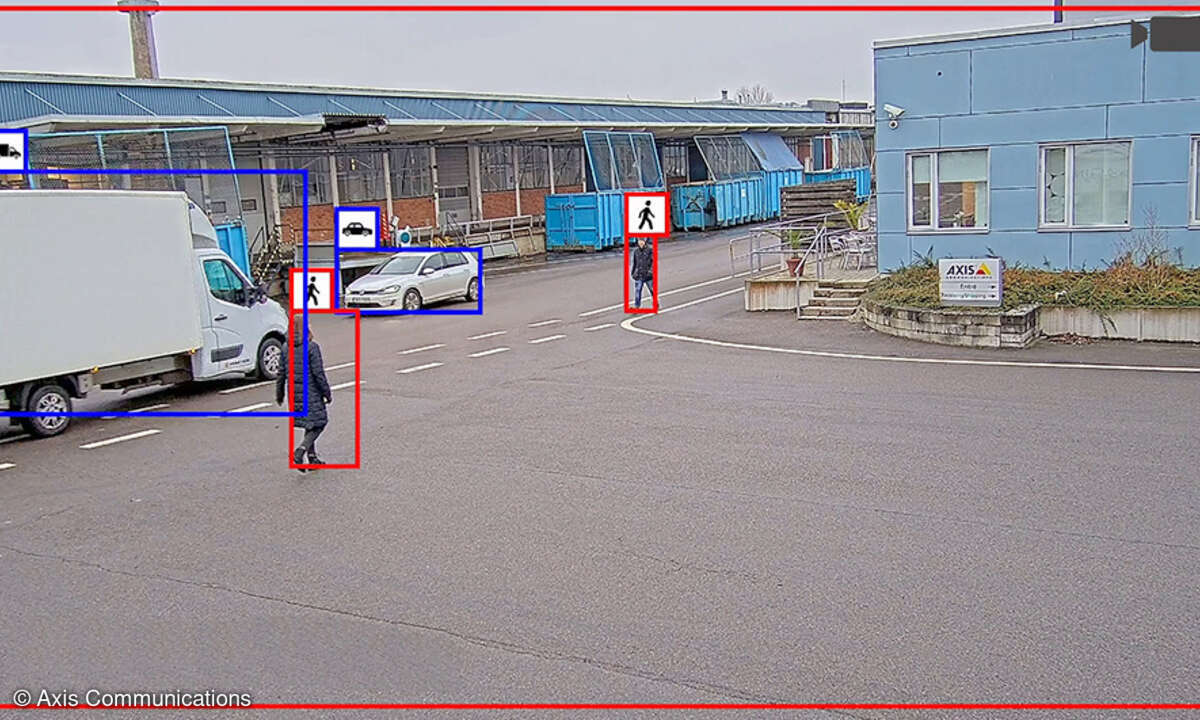

KI-gestützte Objektklassifizierung: Videoanalyse neu gedacht

Das Herzstück dieser KI-basierten Analytikfunktionen ist die Objektklassifizierung. In der Vergangenheit basierte die Analyse von Videomaterial auf der Erkennung von Pixeländerungen im Bildausschnitt – sobald sich eine bestimmte Anzahl an Pixeln änderte, beispielsweise wenn ein vorbeifahrendes Fahrzeug die Fläche dahinter verdeckte, wurde ein Alarm ausgelöst. Dabei wurde jedoch nicht berücksichtigt, was die Pixeländerungen tatsächlich auslöste – eine Unterscheidung zwischen einzelnen Fahrzeugtypen oder zwischen Fahrzeug und Person war nicht möglich.

Bei einer modernen KI-Analyse, die eine hochdifferenzierte Objektklassifizierung umfasst, wird im obigen Fall das Fahrzeug als solches klassifiziert und gleichzeitig beispielsweise erfasst, um welchen Fahrzeugtyp es sich handelt, ob es in sich in einem vorher definierten Bereich befindet oder ob sich potenziell gefährdete Personen in der Nähe des Fahrzeugs befinden.

Um diese Klassifizierung zu ermöglichen, werden anhand von Beispieldaten Modelle „trainiert“, die in Anwendungen integriert und auf den MLPUs und DLPUs in den Kameras ausgeführt werden können. Wichtig dabei ist, dass die Beispieldaten repräsentativ, qualitativ hochwertig und eindeutig benannt sind, damit das KI-Modell versteht, was in welchem Bild und aus welchem Neigungs- und Blickwinkel zu sehen ist, damit es ähnliche Objekte später auch in verschiedenen Perspektiven und Lichtverhältnissen identifizieren kann.

Kann die KI ein Objekt im Bildausschnitt identifizieren und klassifizieren, leitet sie bestimmte, vorher definierte Aktionen ein, beispielsweise das Auslösen eines Alarms oder das Speichern des relevanten Bildmaterials. Ein Alarm kann zum Beispiel ausgelöst werden, wenn eine Person einen markierten Bereich im Bildausschnitt betritt oder eine virtuelle Markierung überschreitet.