Mehr Rechenleistung allein reicht nicht

Warum das Zeitalter der KI-Agenten intelligente Architekturen verlangt.

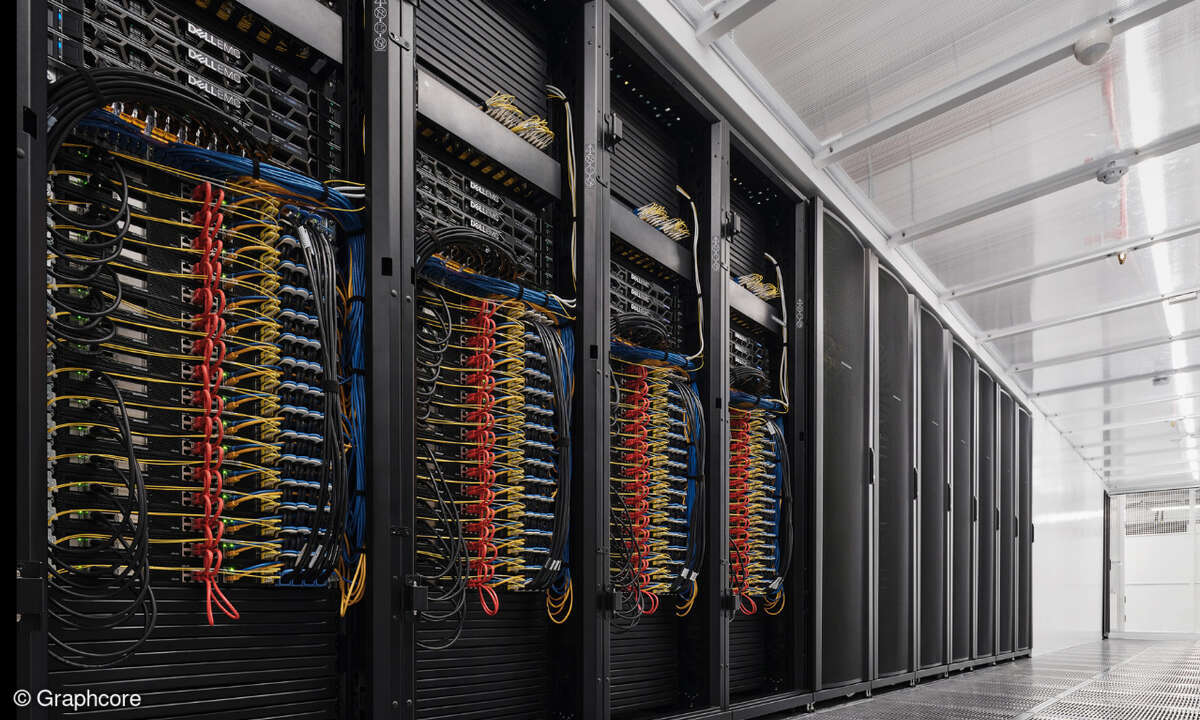

Mit der Eröffnung des neuen KI-Rechenzentrums in München setzt Deutschland ein starkes Zeichen. Hochleistungsinfrastruktur, spezialisierte GPUs und milliardenschwere Investitionen sollen Europa im globalen KI-Wettlauf stärken. Die politische Botschaft ist eindeutig: Wer mithalten will, braucht mehr Rechenleistung. Das ist zweifellos ein wichtiger Schritt. Was jedoch häufig übersehen wird: Für die strategische Wettbewerbsfähigkeit Deutschlands und Europas ist Infrastruktur nur eine Seite der Medaille.

Denn in der Unternehmenspraxis zeigt sich: KI-Projekte scheitern selten an fehlenden GPUs. Sie scheitern daran, dass Systeme nicht stabil, kontrollierbar und transparent genug arbeiten. Sobald KI in Kernprozesse eingreift, wird Beherrschbarkeit zur Voraussetzung – für sicheren Betrieb ebenso wie für wirtschaftliche Leistungsfähigkeit.

Agentische Systeme verschärfen diese Herausforderung weiter. Wenn KI eigenständig plant, externe Tools nutzt und Entscheidungen vorbereitet oder ausführt, steigt die systemische Komplexität deutlich. Autonomie erweitert den Handlungsspielraum – und erhöht zugleich die Tragweite möglicher Fehler.

Zusätzliche Rechenleistung allein löst dieses Problem nicht. Gefragt sind Systemarchitekturen, die Stabilität, Nachvollziehbarkeit und strukturelle Kontrolle von Beginn an gewährleisten.

Die strukturelle Grenze probabilistischer Modelle

Der Grund dafür, dass auch immer größere Sprachmodelle unweigerlich an strukturelle Grenzen stoßen, liegt in ihrem Funktionsprinzip. Sie berechnen Wahrscheinlichkeiten für das nächste Token. Mehr Parameter und mehr GPUs erhöhen zwar die statistische Genauigkeit, sie verändern jedoch nicht die Art, wie Ergebnisse zustande kommen.

Sobald KI in operative Prozesse eingebunden wird oder Entscheidungen vorbereitet, reicht statistische Plausibilität nicht mehr aus. Gerade in regulierten oder geschäftskritischen Bereichen müssen Ergebnisse stabil, reproduzierbar und regelkonform sein. Fehlentscheidungen bleiben in solchen Kontexten nicht folgenlos: Sie können Haftungsfragen auslösen, operative Abläufe stören und wirtschaftliche Schäden verursachen.

In agentischen Systemen zeigt sich diese Problematik besonders deutlich. Autonome Entscheidungen greifen unmittelbar in weitere Abläufe ein. Fehler bleiben dann nicht isoliert, sondern können sich entlang der Prozesskette fortpflanzen und mit jedem weiteren Schritt verstärken.

Unter diesen Bedingungen stoßen auch nachgelagerte Schutzmechanismen an Grenzen. Guardrails, Prompt-Vorlagen oder manuelle Validierungen können Risiken reduzieren. Sie greifen jedoch außerhalb des eigentlichen Entscheidungsmechanismus und erhöhen mit wachsender Autonomie den Wartungs- und Abstimmungsaufwand.

Im anbrechenden Agentenzeitalter reicht es daher nicht, Regeln nachträglich durchzusetzen. Kontrolle im Sinne vollständiger Beherrschbarkeit muss im Systemdesign selbst angelegt sein. Nur so lassen sich Stabilität, Verlässlichkeit und Skalierbarkeit dauerhaft erreichen. Kontrolle ist damit kein regulatorisches Detail, sondern die Voraussetzung produktiver KI-Systeme.

Steuerbarkeit und Nachvollziehbarkeit als Designprinzipien

Für Unternehmen bedeutet das: Wer KI produktiv skalieren will, muss sich mit der Architektur seiner Systeme beschäftigen. Autonome Anwendungen werden zunehmend Teil operativer Wertschöpfungsketten und greifen damit unmittelbar in zentrale Geschäftsprozesse ein. In agentischen Systemen muss Kontrolle daher auf drei Ebenen der Architektur verankert sein:

- 1. Workflow-Ebene: Agentische Systeme bestehen nicht aus einzelnen Modellaufrufen, sondern aus komplexen Ablaufketten: Planungsschritte, Tool-Aufrufe, Datenzugriffe und Rückkopplungen zwischen mehreren Komponenten. Schon kleine Änderungen – etwa an Prompts, Modellversionen oder Parametern – können das Verhalten eines Workflows spürbar verändern. Ohne systematische Beobachtbarkeit von Ausführungen, Konfigurationsänderungen und Abweichungen bleibt diese Dynamik schwer nachvollziehbar. Stabiler Betrieb setzt daher voraus, dass agentische Prozesse wie Software-Systeme behandelt werden: mit klar nachvollziehbaren Ausführungspfaden, Versionierung und Analyse von Laufzeitunterschieden.

- Wissens- und Kontextebene: Sgenten arbeiten nicht nur mit Trainingswissen, sondern greifen laufend auf Dokumente, Datenbanken oder externe Quellen zu. Wie diese Informationen aufbereitet, gefiltert und bereitgestellt werden, bestimmt maßgeblich die Qualität der Ergebnisse. Kontextmanagement umfasst daher die strukturierte Aufnahme und Aufbereitung von Daten, klare Zugriffsbeschränkungen und die kontrollierte Bereitstellung von Wissen in unterschiedlichen Nutzungskontexten. Ohne diese Struktur entstehen leicht Systeme, die über große Informationsmengen verfügen, diese aber nicht konsistent oder regelkonform nutzen.

- Entscheidungsebene: Die größte Herausforderung liegt jedoch auf der Entscheidungsebene. Sprachmodelle erzeugen Schlussfolgerungen auf probabilistischer Basis. Sie besitzen keine inhärente Struktur zur Durchsetzung formaler Regeln oder Zielvorgaben. In der Praxis werden Policies deshalb häufig außerhalb des Modells geprüft – etwa durch Guardrails oder nachgelagerte Validierungsschritte. Damit bleibt der eigentliche Entscheidungsprozess statistisch, während Regelkonformität erst im Nachhinein kontrolliert wird.

In agentischen Systemen reicht das nicht aus. Wenn Entscheidungen operative Wirkung entfalten, müssen sie nicht nur plausibel erscheinen, sondern technisch nachvollziehbar und regelgebunden zustande kommen. Dafür braucht es Architekturen, in denen Entscheidungslogik selbst strukturiert abgebildet wird – etwa durch explizite Regelräume, überprüfbare Schlussketten oder formalisierte Zielhierarchien.

Erst wenn Workflow, Kontext und Entscheidung strukturell ineinandergreifen, lassen sich agentische Systeme stabil betreiben und skalieren. In der Praxis zeigt sich: Die größten Effekte entstehen, wenn diese Kontrollmechanismen nicht isoliert aufgebaut werden, sondern als integrierte Architektur. Besonders schnell gelingt das dort, wo Unternehmen diese Strukturen gemeinsam mit erfahrenen Partnern und ihren eigenen Teams implementieren – und das notwendige Wissen parallel in der Organisation aufbauen.

Eine strategische Chance für Europa

Im Agentenzeitalter ist Beherrschbarkeit keine nachgelagerte Frage der Regulierung, sondern die Voraussetzung für reale Wertschöpfung. Autonome Systeme entfalten ihren wirtschaftlichen Nutzen nur dort, wo ihr Betrieb stabil, nachvollziehbar und kontrollierbar organisiert ist.

Genau hier liegt eine strategische Chance für Europa. Mit seiner Tradition der Ingenieurskunst, hohen Qualitätsstandards und einem ausgeprägten Verantwortungsbewusstsein im Umgang mit Technologie kann Europa intelligente und kontrollierbare KI-Architekturen vorantreiben. Entscheidend wird sein, mehr Wertschöpfung pro eingesetzter Recheneinheit zu erzielen – gerade in Europa, wo Energie ein teurer und begrenzter Produktionsfaktor ist.

Rechenzentren bleiben notwendig. Doch sie allein entscheiden nicht über die Zukunftsfähigkeit einer Volkswirtschaft. Entscheidend ist, ob es gelingt, Autonomie so zu gestalten, dass daraus stabile operative Performance entsteht.

Nicht nur größer rechnen – sondern intelligenter bauen. Genau darin liegt Europas Chance.