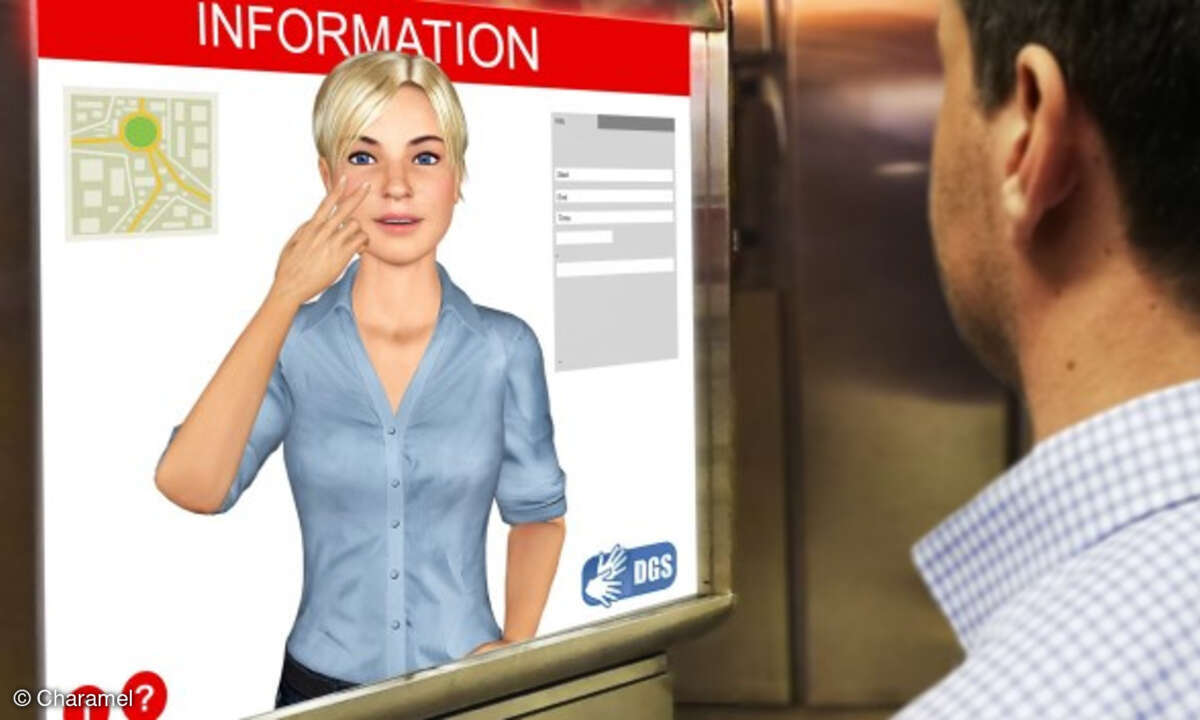

Barrierefreie Kommunikation mit 3D-Gebärdensprach-Avatar

Etwa 70 Millionen gehörlose Menschen gibt es weltweit. Um auf ihre Bedürfnisse einzugehen, braucht es barrierefreie digitale Kommunikation, die die Gebärdensprache nutzt. Hierfür unterstützt die deutsche Bundesregierung das Projekt "Avasag".

Das Verbundprojekt "Avasag" (Avatar-basierter Sprachassistent zur automatisierten Gebärdenübersetzung) wird vom Bundesministerium für Bildung und Forschung gefördert. Dabei sollen Experten einen 3D-Gebärdensprach-Avatar entwickeln. Dadurch soll der Informationsbedarf von gehörlosen Bürgern besser abgedeckt, aber auch Behörden sowie öffentliche Stellen mit einer Möglichkeit zur barrierefreien digitalen Kommunikation versorgt werden.

Dieser Weg der Digitalisierung der Gesellschaft zielt auf eine erhöhte Inklusion ab. Für Menschen mit Behinderung soll eine gesellschaftliche Teilhabe gewährleistet werden. Das vom BMBF unterstützte Projekt verfolgt die Entwicklung eines echtzeitgesteuerten 3D-Gebärdensprach-Avatars, der deutsche Texte automatisch in Gebärdensprache übersetzt. Dabei soll eine neue Gebärdenanimationsmethode für 3D-Avatare entstehen. Maschinelles Lernen wird mit regelbasierten Synthesemethoden, die Text in Gebärden abbilden, kombiniert. Um eine qualitativ hochwertige und realistische Darstellung zu erreichen, werden die zeitlichen und räumlichen Abhängigkeiten der komplexen Gebärdenelemente sehr genau aufgelöst. Dadurch werden gehörlose und hörbehinderte Menschen stärker in die Digitale Gesellschaft integriert. Die Gehörlosen-Zielgruppe wird dabei auch zu den Ergebnissen des Projekts hinzugezogen, um diese zu evaluieren.

Das Projektvolumen beträgt 1,98 Millionen Euro, wovon etwa 74 Prozent Förderanteil durch das BMBF sind. Unter der Leitung von Charamel, einem Spezialisten für interaktive Avatar-basierte Assistenzsysteme, soll das Projekt vom 1. Mai 2020 bis zum 30. April 2023 laufen. Neben Charamel arbeiten auch die Unternehmen Yomma und Ergosign an dem Projekt mit. Aber auch Forschungseinrichten nehmen teil: das Deutsche Forschungszentrum für Künstliche Intelligenz mit den Forschungsbereichen "Kognitive Assistenzsysteme" und "Sprachtechnologie und Multilingualität", das Institut für Medien- und Phototechnik der Technischen Hochschule Köln sowie die Abteilung Human Centered Multimedia der Universität Augsburg.