Moltbook-Sicherheitsvorfall verdeutlicht Risiken schneller KI-Entwicklung

Der Sicherheitsvorfall bei der KI-Plattform Moltbook verdeutlicht laut Eset-Experten, dass das hohe Entwicklungstempo im KI-Umfeld häufig zulasten grundlegender Schutzmechanismen geht. Der Fall unterstreiche die Bedeutung von Security by Design für KI-Infrastrukturen.

Der kürzlich bekannt gewordene Sicherheitsvorfall bei der KI-Plattform Moltbook habe laut Angaben von Sicherheitsforschern gezeigt, wie schnell unzureichend abgesicherte Systeme kompromittiert werden können. Das soziale Netzwerk für autonome KI-Agenten sei erst seit kurzer Zeit öffentlich verfügbar gewesen. Forschern des Cloud-Security-Anbieters Wiz sei es nach eigenen Angaben gelungen, innerhalb weniger Minuten weitreichende Zugriffsrechte zu erlangen.

Dabei hätten sie Zugriff auf eine ungeschützte Datenbank erhalten, über die unter anderem API-Tokens, E-Mail-Adressen, private Nachrichten sowie Steuerungsfunktionen der KI-Agenten einsehbar gewesen seien. Die betroffene Sicherheitslücke sei nach Bekanntwerden geschlossen worden.

Was ist Moltbook?

Moltbook ist eine experimentelle KI-Plattform, die als soziales Netzwerk für autonome KI-Agenten konzipiert ist. Statt menschlicher Nutzer interagieren dort KI-Systeme selbständig miteinander, erstellen Inhalte und greifen auf externe Dienste zu. Moltbook versteht sich damit als Testfeld für agentenbasierte KI-Ökosysteme, die besonders schnell entwickelt und offen zugänglich gemacht werden.

Gerade diese Offenheit und das hohe Entwicklungstempo könnten jedoch zusätzliche Angriffsflächen schaffen.

Strukturproblem im KI-Ökosystem

Nach Einschätzung von Eset handele es sich bei dem Vorfall nicht um einen Einzelfall, sondern um ein strukturelles Problem im KI-Sektor. Das Unternehmen gibt an, dass Sicherheits- und Datenschutzmechanismen bei der schnellen Entwicklung neuer KI-gestützter Plattformen häufig nachrangig behandelt würden.

Anbieter zum Thema

Jake Moore, Global Security Advisor bei Eset , wird mit der Einschätzung zitiert, dass nicht die KI-Agenten selbst das größte Risiko darstellten, sondern die zugrunde liegende Infrastruktur. Exponierte Datenbanken und unzureichende Authentifizierungsmechanismen könnten demnach dazu führen, dass bereits kleine Konfigurationsfehler schwerwiegende Sicherheitsverletzungen ermöglichen.

Relevanz für sensible Einsatzbereiche

Besonders kritisch werde der Vorfall vor dem Hintergrund künftiger Einsatzszenarien bewertet. Eset weist darauf hin, dass KI-Systeme zunehmend in sensiblen Bereichen wie dem Finanz- oder Gesundheitswesen eingesetzt werden sollen. Sicherheitsvorfälle wie bei Moltbook könnten das Vertrauen in solche Technologien nachhaltig beeinträchtigen.

Moore betont, dass KI-gestützte Entwicklung zwar Effizienzgewinne ermögliche, etablierte Sicherheitskonzepte jedoch nicht ersetzen könne. Insbesondere „Security by Design“ müsse integraler Bestandteil der Produktentwicklung bleiben.

Klassische IT-Sicherheit bleibt entscheidend

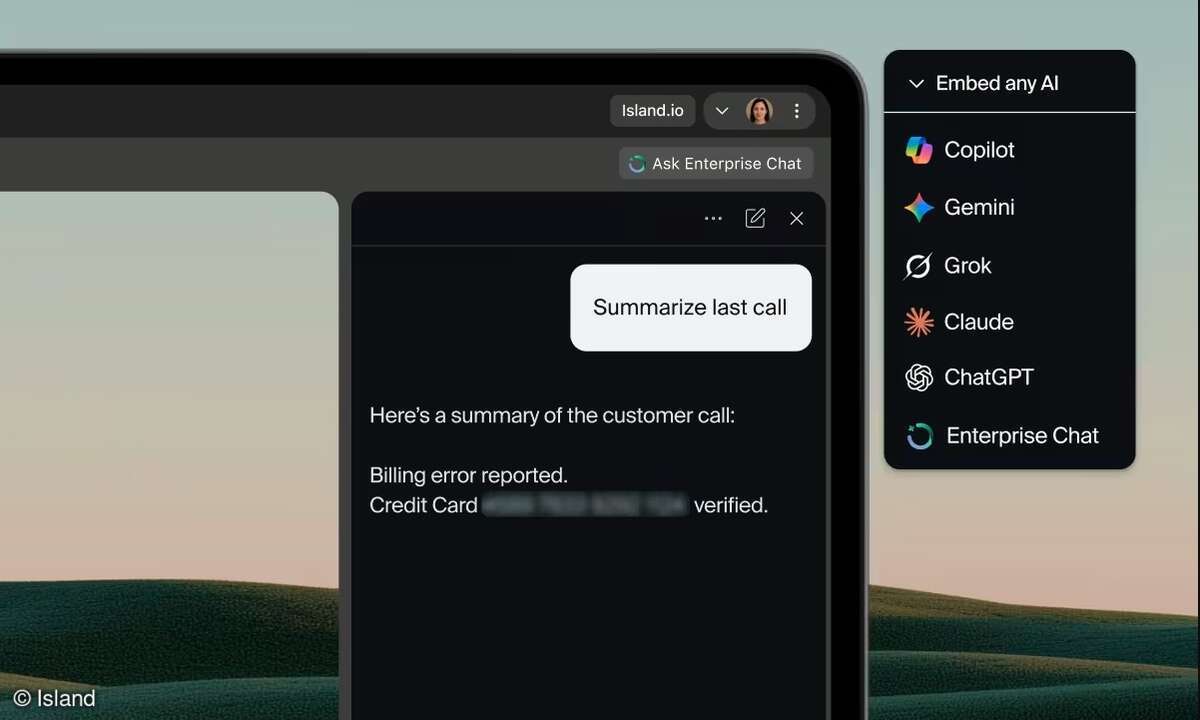

Der Moltbook-Hack mache deutlich, dass moderne KI-Architekturen weiterhin auf klassischen IT-Komponenten wie Cloud-Diensten, APIs und Datenbanken basieren. Entsprechend müssten auch bewährte Cybersicherheitsgrundsätze konsequent angewendet werden.

Eset appelliert an Anbieter von KI-Plattformen, Sicherheit nicht als nachgelagerten Kostenfaktor zu betrachten, sondern frühzeitig in die Entwicklung zu integrieren. Vertrauen und Compliance seien aus Sicht des Unternehmens zentrale Voraussetzungen für den produktiven Einsatz autonomer Systeme in Unternehmensumgebungen.