Open-Source-Software sicher machen

Ein Großteil der Unternehmen setzt Software ein, die Open-Source-Komponenten enthält. Das bringt Vorteile mit sich, etwa kürzere Entwicklungszeiten bei Applikationen. Doch ein beträchtlicher Teil der Open-Source-Software enthält Sicherheitslücken. Allerdings lassen sich die Risiken minimieren.

- Open-Source-Software sicher machen

- "Best Practices" machen Open Source sicher

xOpen-Source-Software gehört zweifellos die Zukunft. Der Umsatz mit entsprechenden Lösungen wird nach Einschätzung von Veracode im Jahr 2020 weltweit an die 57 Milliarden Dollar betragen. Doch Open Source hat mehrere Facetten. Auf der einen Seite ist solche Software heute für Entwickler von Applikationen unverzichtbar. Denn es ist schlichtweg nicht praktikabel, alle Software-Komponenten in Eigenregie zu entwickeln. Dann wären Release-Zyklen von wenigen Wochen oder gar Tagen, wie sie heute üblich sind, schlichtweg unmöglich.

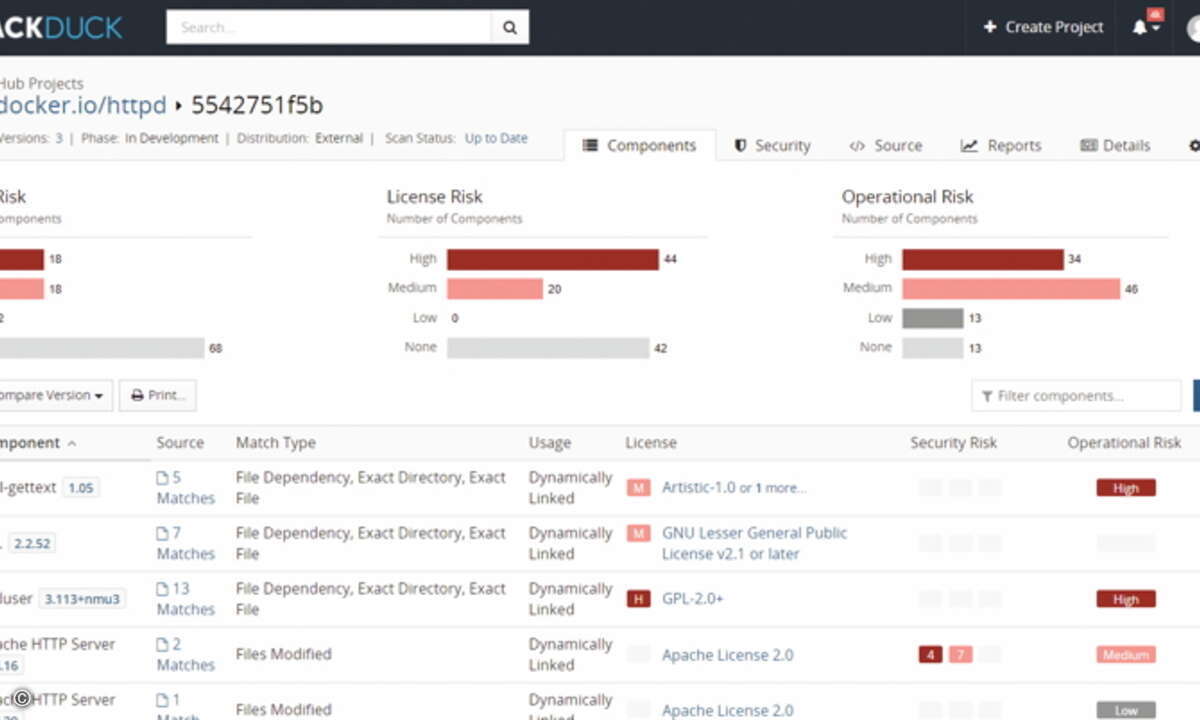

Auf der anderen Seite können Open-Source-Lösungen das Risiko erhöhen, dass ein Unternehmen gegen Compliance-Vorgaben verstößt und bei Audits "durchfällt". Das bestätigt die Studie "The State of Software Security 2017" von Veracode. Demnach wiesen 44 Prozent aller Anwendungen kritische Schwachstellen auf, für die Open-Source-Komponenten verantwortlich sind. Welche Folgen das haben kann, zeigte die Cyber-Attacke auf das öffentliche Nahverkehrssystem in San Francisco im November 2016. Kriminelle nutzten eine Schwachstelle in den Apache Commons Collections, um mehr als 2.100 Rechner des Unternehmens mit einer Erpresser-Software (Ransomware) zu infizieren.

Doch solche Schwachstellen sind kein Grund, auf Open-Source-Komponenten zu verzichten. Das wäre auch angesichts des Siegeszuges von Ansätzen wie DevOps auch gar nicht möglich. Wichtig ist vielmehr, dass sich Unternehmen darüber im Klaren sind, welche Risiken mit dem Einsatz von Open-Source-Software verbunden sind und wie sich diese minimieren lassen.

"Linus' Gesetz" reicht nicht aus

Fahrlässig wäre, sich alleine auf "Linus' Gesetz" zu verlassen. Es besagt, dass die meisten Schwachstellen in Open-Source-Software durch die permanente Analyse durch Entwickler und Anwender entdeckt und eliminiert werden. Dass dies nicht zutrifft, zeigte vor einigen Jahren die "Heartbleed"-Sicherheitslücke in der OpenSSL-Bibliothek. Sie blieb mehr als zwei Jahre lang unentdeckt. Hinzu kommt, dass es einen erheblichen Unterschied darstellt, ob ein Software-Fachmann Code anderer Entwickler verwendet oder selbst Programme entwickelt. In der Regel ist es einfacher, eigenen Programmcode auf Fehler hin zu überprüfen als die Software anderer Programmierer. Zudem sind nicht genügend erfahrene Software-Spezialisten vorhanden, die Open-Source-Code unter die Lupe nehmen können.

Ist daher Open-Source-Software weniger sicher als kommerzielle Applikationen, deren Code von den Anbietern nicht zugänglich gemacht wird? Nein, wie die Studie von Veracode belegt. Demnach fielen 2017 mehr als 77 Prozent der kommerziellen Software-Pakete bei Sicherheits-Scans durch, die auf den Vorgaben des Open Web Application Security Project (OWASP) basierten. Bei Software, die Unternehmen selbst entwickelten, lag der Wert nur bei 65 Prozent. Solche Tests dienen dazu, Schwachstellen in Programmcode sichtbar zu machen. Hinzu kommt ein weiterer Punkt: Nutzer von kommerzieller Software sind darauf angewiesen, dass der Anbieter Sicherheitslücken schließt. Bei Open-Source-Lösungen haben Software-Spezialisten dagegen die Option, nötigenfalls selbst einen Patch zu schreiben.